Bảo vệ dữ liệu cá nhân trong trí tuệ nhân tạo (AI) là nghĩa vụ pháp lý bắt buộc, đòi hỏi doanh nghiệp phải áp dụng các biện pháp bảo mật nghiêm ngặt và tuân thủ đạo đức trong suốt vòng đời của hệ thống. Để đảm bảo tuân thủ và phát triển bền vững, DPO.VN cung cấp giải pháp toàn diện giúp doanh nghiệp áp dụng đúng quy định về an ninh dữ liệu AI. An toàn thông tin, tuân thủ pháp luật, đạo đức AI.

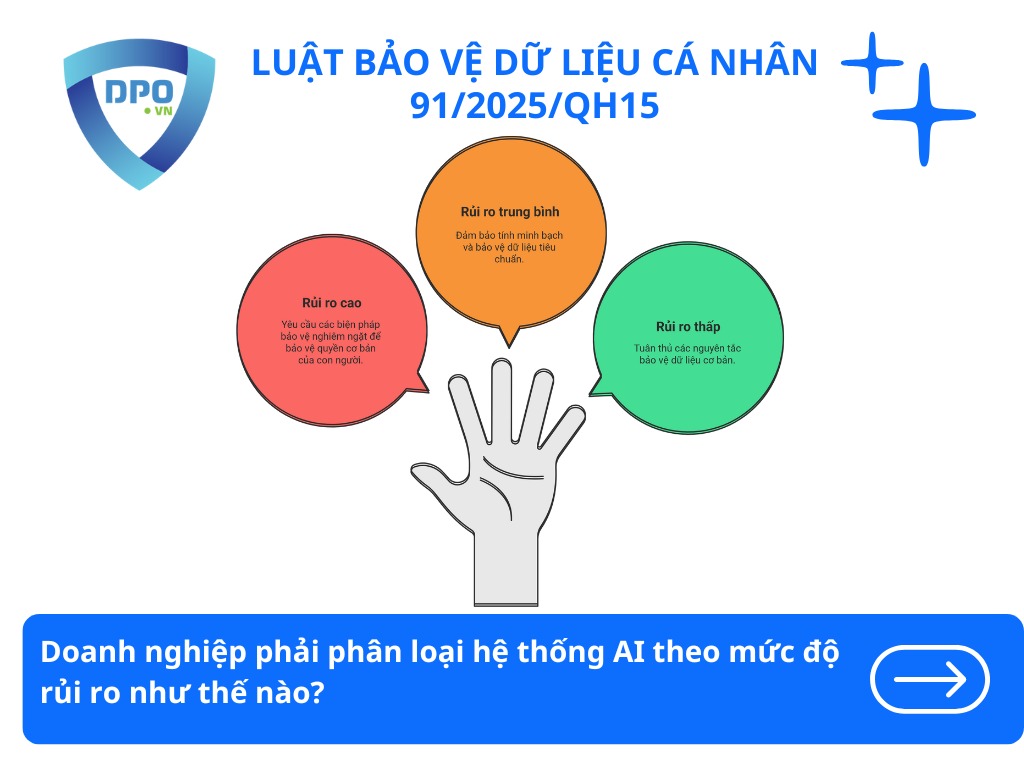

Doanh nghiệp phải phân loại hệ thống AI theo mức độ rủi ro như thế nào?

Doanh nghiệp phải phân loại hệ thống AI theo mức độ rủi ro để có biện pháp bảo vệ dữ liệu cá nhân phù hợp, theo quy định tại khoản 4 Điều 30 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15.

Việc phân loại hệ thống AI theo rủi ro là một yêu cầu hoàn toàn mới và mang tính đột phá, được quy định tại khoản 4 Điều 30 của Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15. Đây là nền tảng để doanh nghiệp xác định các nghĩa vụ bảo vệ tương ứng, đảm bảo rằng các biện pháp được áp dụng là tương xứng với mức độ tác động tiềm tàng của AI đến quyền và lợi ích của chủ thể dữ liệu. Mặc dù Luật chưa quy định chi tiết các cấp độ, dựa trên kinh nghiệm từ các quy định quốc tế như AI Act của EU, doanh nghiệp có thể chủ động phân loại hệ thống AI của mình theo ba mức độ rủi ro chính:

- Rủi ro cao: Bao gồm các hệ thống AI có khả năng tác động đáng kể đến quyền cơ bản của con người. Ví dụ: hệ thống chấm điểm tín dụng, AI trong tuyển dụng nhân sự, chẩn đoán y tế, hoặc các hệ thống được sử dụng bởi cơ quan thực thi pháp luật. Đối với nhóm này, doanh nghiệp cần áp dụng các biện pháp bảo vệ nghiêm ngặt nhất, bao gồm thực hiện hồ sơ đánh giá tác động xử lý dữ liệu cá nhân chi tiết, đảm bảo tính minh bạch và khả năng giải thích của mô hình, và có cơ chế giám sát chặt chẽ bởi con người.

- Rủi ro trung bình: Các hệ thống AI có tương tác trực tiếp với con người nhưng ít có khả năng gây tổn hại nghiêm trọng. Ví dụ: chatbots chăm sóc khách hàng, hệ thống đề xuất sản phẩm cá nhân hóa. Doanh nghiệp cần đảm bảo tính minh bạch bằng cách thông báo rõ ràng cho người dùng rằng họ đang tương tác với một hệ thống AI. Các biện pháp bảo vệ dữ liệu tiêu chuẩn như mã hóa, kiểm soát truy cập vẫn là yêu cầu bắt buộc.

- Rủi ro thấp: Gồm các hệ thống AI có tác động tối thiểu đến quyền riêng tư. Ví dụ: AI trong các trò chơi điện tử, bộ lọc spam email. Mặc dù rủi ro thấp, doanh nghiệp vẫn phải tuân thủ các nguyên tắc bảo vệ dữ liệu cơ bản như thu thập dữ liệu hợp pháp và có mục đích rõ ràng.

Luật sư Nguyễn Tiến Hảo chia sẻ: Việc chủ động phân loại rủi ro không chỉ giúp doanh nghiệp tuân thủ pháp luật mà còn là một bước đi chiến lược trong quản trị rủi ro. Bằng cách xác định sớm các hệ thống AI có rủi ro cao, doanh nghiệp có thể tập trung nguồn lực để xây dựng các biện pháp kiểm soát phù hợp, từ đó giảm thiểu nguy cơ vi phạm và bảo vệ uy tín thương hiệu một cách hiệu quả.

Cơ sở pháp lý nào cho việc thu thập và sử dụng dữ liệu để huấn luyện AI?

Cơ sở pháp lý chính là sự đồng ý rõ ràng, tự nguyện của chủ thể dữ liệu, hoặc các trường hợp được pháp luật cho phép xử lý không cần sự đồng ý, với điều kiện phải tuân thủ nghiêm ngặt nguyên tắc giới hạn mục đích.

Việc huấn luyện các mô hình AI đòi hỏi một khối lượng dữ liệu khổng lồ, và việc thu thập, sử dụng nguồn dữ liệu này phải có cơ sở pháp lý vững chắc. Pháp luật Việt Nam đặt ra các yêu cầu rõ ràng để đảm bảo quyền lợi của chủ thể dữ liệu không bị xâm phạm trong quá trình này.

Làm thế nào để có được sự đồng ý hợp lệ cho việc huấn luyện AI?

Sự đồng ý phải được thu thập một cách minh bạch, cho từng mục đích cụ thể, bao gồm cả mục đích huấn luyện AI, và chủ thể dữ liệu phải được thông báo đầy đủ về cách thức dữ liệu của họ sẽ được sử dụng.

Theo Điều 11 của Nghị định 13/2023/NĐ-CP, sự đồng ý của chủ thể dữ liệu phải dựa trên sự tự nguyện và việc họ biết rõ các thông tin cần thiết. Khi áp dụng vào AI, điều này có nghĩa là:

- Mục đích rõ ràng: Doanh nghiệp không thể chỉ nêu chung chung là thu thập dữ liệu để cải thiện dịch vụ. Thay vào đó, cần nêu rõ mục đích là để huấn luyện các mô hình học máy nhằm cá nhân hóa trải nghiệm, phát hiện gian lận, hay một mục tiêu cụ thể khác.

- Tách biệt sự đồng ý: Nếu dữ liệu được thu thập cho nhiều mục đích (ví dụ: xử lý đơn hàng và huấn luyện AI), doanh nghiệp phải có cơ chế để chủ thể dữ liệu đồng ý riêng cho từng mục đích. Họ không thể bị ép buộc phải đồng ý cho việc huấn luyện AI để được sử dụng một dịch vụ cơ bản.

- Thông tin đầy đủ: Chủ thể dữ liệu cần được biết loại dữ liệu nào sẽ được dùng để huấn luyện (ví dụ: lịch sử mua sắm, hành vi lướt web), và dữ liệu đó có thể được chia sẻ với bên thứ ba (nhà cung cấp nền tảng AI) hay không.

Sử dụng dữ liệu đã khử nhận dạng để huấn luyện AI có cần tuân thủ điều kiện gì không?

Có, doanh nghiệp phải đảm bảo quá trình khử nhận dạng được thực hiện an toàn, hiệu quả và không được tái nhận dạng dữ liệu, trừ khi pháp luật cho phép.

Khoản 1 Điều 2 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15 quy định rằng dữ liệu sau khi được khử nhận dạng sẽ không còn là dữ liệu cá nhân. Điều này mở ra một hướng đi tiềm năng cho việc huấn luyện AI mà không cần sự đồng ý. Tuy nhiên, khoản 6 Điều 14 của Luật này cũng đặt ra các điều kiện nghiêm ngặt:

- Kiểm soát chặt chẽ: Quá trình khử nhận dạng phải được giám sát để ngăn chặn rò rỉ dữ liệu gốc.

- Không tái nhận dạng: Doanh nghiệp không được cố gắng tái nhận dạng dữ liệu đã được khử, trừ trường hợp đặc biệt do pháp luật quy định. Điều này đòi hỏi các kỹ thuật khử nhận dạng phải đủ mạnh để chống lại các nỗ lực liên kết lại dữ liệu với một cá nhân cụ thể.

DPO.VN nhấn mạnh rằng, việc dựa vào cơ sở dữ liệu đã khử nhận dạng đòi hỏi doanh nghiệp phải có chuyên môn kỹ thuật cao để thực hiện đúng cách và chứng minh được rằng dữ liệu đó thực sự không thể tái nhận dạng.

Làm sao để đảm bảo tính minh bạch, công bằng và đạo đức khi AI ra quyết định?

Doanh nghiệp phải đảm bảo hệ thống AI tuân thủ các chuẩn mực đạo đức, thuần phong mỹ tục của Việt Nam, có cơ chế giải thích các quyết định của AI và ngăn chặn sự phân biệt đối xử.

Khi các hệ thống AI ngày càng tham gia sâu vào việc đưa ra các quyết định ảnh hưởng trực tiếp đến con người, từ việc duyệt hồ sơ vay vốn đến chẩn đoán bệnh, yêu cầu về tính minh bạch, công bằng và đạo đức trở nên vô cùng cấp thiết. Khoản 2 Điều 30 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15 đã đặt ra nền tảng pháp lý cho vấn đề này.

Để tuân thủ, doanh nghiệp cần:

- Xây dựng Khung Đạo đức AI: Doanh nghiệp nên phát triển một bộ quy tắc đạo đức nội bộ cho việc phát triển và triển khai AI, dựa trên các giá trị cốt lõi như công bằng, minh bạch và trách nhiệm. Khung này phải phù hợp với chuẩn mực đạo đức và thuần phong mỹ tục của Việt Nam.

- Đảm bảo khả năng giải thích (Explainability): Mặc dù pháp luật chưa có quy định cụ thể về quyền được giải thích như GDPR của EU, nguyên tắc minh bạch (Điều 3 Nghị định 13/2023/NĐ-CP) đã hàm ý rằng doanh nghiệp phải có khả năng giải thích ở mức độ nhất định cách thức AI đưa ra quyết định, đặc biệt là các quyết định bất lợi cho chủ thể dữ liệu. Ví dụ, nếu một hồ sơ vay bị từ chối bởi AI, ngân hàng nên có khả năng cung cấp các lý do chính dẫn đến quyết định đó.

- Kiểm tra và giảm thiểu thiên vị (Bias): Các mô hình AI có thể học và khuếch đại các thành kiến có sẵn trong dữ liệu huấn luyện, dẫn đến sự phân biệt đối xử. Doanh nghiệp phải thường xuyên kiểm tra các mô hình AI của mình để phát hiện và giảm thiểu các thiên vị liên quan đến giới tính, dân tộc, vùng miền hay các yếu tố nhạy cảm khác.

- Giám sát bởi con người: Đối với các quyết định có rủi ro cao, cần thiết phải có sự can thiệp và xem xét lại của con người để đảm bảo tính chính xác và công bằng, tránh phụ thuộc hoàn toàn vào quyết định tự động của máy móc.

Cần tích hợp các biện pháp kỹ thuật và quản lý nào vào hệ thống AI?

Doanh nghiệp phải tích hợp các biện pháp bảo mật ngay từ khâu thiết kế (Privacy by Design), bao gồm mã hóa, xác thực, phân quyền truy cập, và áp dụng các biện pháp bảo vệ phù hợp trong suốt vòng đời của hệ thống AI.

Bảo mật không phải là một tính năng bổ sung, mà phải là một phần không thể thiếu trong kiến trúc của hệ thống AI. Khoản 3 Điều 30 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15 yêu cầu các hệ thống và dịch vụ AI phải được tích hợp các biện pháp bảo mật phù hợp.

Các biện pháp bảo vệ dữ liệu cá nhân cần thiết bao gồm:

| Biện pháp Kỹ thuật | Biện pháp Quản lý |

|---|---|

| Mã hóa dữ liệu: Dữ liệu cá nhân phải được mã hóa cả khi lưu trữ (at rest) và khi truyền đi (in transit) để bảo vệ khỏi việc truy cập trái phép. | Chính sách bảo vệ dữ liệu: Xây dựng và ban hành các quy định nội bộ rõ ràng về việc xử lý dữ liệu cá nhân trong các dự án AI. |

| Kiểm soát truy cập: Áp dụng nguyên tắc quyền tối thiểu (least privilege), đảm bảo nhân viên chỉ có thể truy cập vào lượng dữ liệu cần thiết cho công việc của họ. | Đào tạo nhận thức: Tổ chức các buổi đào tạo định kỳ cho đội ngũ phát triển AI và các bên liên quan về các quy định pháp luật và rủi ro bảo mật. |

| Ghi nhật ký và giám sát: Theo dõi và ghi lại mọi hoạt động truy cập và xử lý dữ liệu để phát hiện sớm các hành vi bất thường và phục vụ cho việc điều tra khi có sự cố. | Đánh giá tác động: Thực hiện đánh giá tác động xử lý dữ liệu cá nhân trước khi triển khai bất kỳ hệ thống AI mới nào. |

| Bảo mật mô hình AI: Bảo vệ các mô hình AI khỏi các cuộc tấn công đặc thù như tấn công đối kháng (adversarial attacks) hay trích xuất mô hình (model extraction). | Quản lý nhà cung cấp: Nếu sử dụng nền tảng AI của bên thứ ba, cần thẩm định kỹ lưỡng các biện pháp bảo mật của họ và có các điều khoản hợp đồng chặt chẽ. |

Những hành vi và mục đích nào bị nghiêm cấm khi phát triển AI?

Pháp luật nghiêm cấm việc sử dụng và phát triển hệ thống AI có sử dụng dữ liệu cá nhân để gây tổn hại đến quốc phòng, an ninh quốc gia, trật tự an toàn xã hội hoặc xâm phạm đến tính mạng, sức khỏe, danh dự, nhân phẩm, tài sản của người khác.

Pháp luật Việt Nam đã vạch ra những lằn ranh đỏ rõ ràng mà các nhà phát triển và triển khai AI không được phép vượt qua. Khoản 5 Điều 30 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15 là quy định cốt lõi, cấm các hành vi sử dụng AI vào các mục đích tiêu cực. Điều này được củng cố thêm bởi Điều 7 của Luật này và Điều 8 của Nghị định 13/2023/NĐ-CP về các hành vi bị nghiêm cấm nói chung.

Cụ thể, các hành vi bị nghiêm cấm bao gồm:

- Chống lại Nhà nước: Phát triển hoặc sử dụng AI để tạo ra thông tin, dữ liệu nhằm chống lại Nhà nước Cộng hòa xã hội chủ nghĩa Việt Nam.

- Gây phương hại an ninh quốc gia: Sử dụng AI để thực hiện các hoạt động gián điệp mạng, khủng bố mạng, hoặc các hành vi khác gây ảnh hưởng đến an ninh quốc gia và trật tự an toàn xã hội.

- Xâm phạm quyền và lợi ích hợp pháp: Triển khai các hệ thống AI có thể xâm phạm đến tính mạng, sức khỏe, danh dự, nhân phẩm hoặc tài sản của cá nhân, ví dụ như hệ thống giám sát hàng loạt không có cơ sở pháp lý hoặc hệ thống ra quyết định tự động gây thiệt hại cho người dùng.

- Xử lý dữ liệu trái phép: Mọi hoạt động thu thập, sử dụng dữ liệu cá nhân để huấn luyện AI mà không tuân thủ các nguyên tắc và quy định của pháp luật đều bị coi là hành vi bị nghiêm cấm.

Doanh nghiệp vi phạm các quy định này không chỉ đối mặt với các mức phạt hành chính nặng nề mà còn có thể bị truy cứu trách nhiệm hình sự tùy theo mức độ nghiêm trọng của hành vi. Việc tuân thủ không chỉ là nghĩa vụ pháp lý mà còn là cam kết đạo đức đối với xã hội.

Các Câu Hỏi Thường Gặp Về Bảo Vệ Dữ Liệu Cá Nhân Trong AI

1. Sử dụng dữ liệu công khai trên mạng xã hội để huấn luyện AI có hợp pháp không?

Trả lời: Việc này tiềm ẩn nhiều rủi ro pháp lý. Mặc dù dữ liệu đã được công khai, việc thu thập và xử lý hàng loạt cho một mục đích mới (huấn luyện AI) vẫn cần tuân thủ nguyên tắc bảo vệ dữ liệu cá nhân, đặc biệt là nguyên tắc giới hạn mục đích. Doanh nghiệp cần có cơ sở pháp lý rõ ràng, ví dụ như sự đồng ý của người dùng, trước khi thực hiện.

2. Nếu doanh nghiệp sử dụng nền tảng AI của bên thứ ba (ví dụ: OpenAI, Google AI), trách nhiệm bảo vệ dữ liệu thuộc về ai?

Trả lời: Trách nhiệm được chia sẻ. Doanh nghiệp sử dụng dịch vụ thường đóng vai trò là Bên Kiểm soát dữ liệu, chịu trách nhiệm cuối cùng trước chủ thể dữ liệu và pháp luật. Nhà cung cấp nền tảng AI là Bên Xử lý dữ liệu. Doanh nghiệp phải có hợp đồng xử lý dữ liệu chặt chẽ với nhà cung cấp, đảm bảo họ cũng tuân thủ các quy định bảo vệ dữ liệu của Việt Nam, đặc biệt là các quy định về chuyển dữ liệu cá nhân ra nước ngoài.

3. Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15 có áp dụng cho các mô hình AI được huấn luyện trước khi luật có hiệu lực không?

Trả lời: Có. Mặc dù dữ liệu có thể đã được thu thập trước đó, nhưng việc tiếp tục sử dụng, vận hành mô hình AI sau ngày 01/01/2026 được coi là hoạt động xử lý dữ liệu và phải tuân thủ các quy định của Luật mới. Điều 39 của Luật có các quy định chuyển tiếp, nhưng doanh nghiệp nên chủ động rà soát lại các mô hình hiện có để đảm bảo tuân thủ.

4. Doanh nghiệp có cần lập Hồ sơ đánh giá tác động riêng cho từng mô hình AI không?

Trả lời: Không nhất thiết. Theo Điều 21 Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15, việc đánh giá tác động được thực hiện một lần cho suốt thời gian hoạt động và được cập nhật khi có thay đổi. Doanh nghiệp có thể lập một hồ sơ chung cho các hoạt động xử lý dữ liệu của mình, trong đó có một phần riêng đánh giá tác động của các hệ thống AI, phân loại theo rủi ro và mô tả các biện pháp bảo vệ tương ứng.

5. Làm thế nào để đảm bảo AI không vi phạm quyền sở hữu trí tuệ khi tạo ra nội dung mới?

Trả lời: Đây là một lĩnh vực pháp lý phức tạp. Để giảm thiểu rủi ro, doanh nghiệp cần đảm bảo dữ liệu dùng để huấn luyện AI được thu thập hợp pháp và có bản quyền sử dụng rõ ràng. Khi triển khai AI tạo sinh, cần có các bộ lọc và cơ chế kiểm soát để ngăn chặn việc tạo ra các nội dung sao chép trực tiếp hoặc vi phạm bản quyền của các tác phẩm đã có.

Tìm Hiểu Thêm Về Bảo Vệ Dữ Liệu Cá Nhân Cùng DPO.VN

Để xây dựng một chiến lược tuân thủ pháp luật về bảo vệ dữ liệu cá nhân hiệu quả, đảm bảo an toàn thông tin và uy tín cho doanh nghiệp, hãy liên hệ với chuyên gia của DPO.VN. Chúng tôi, Công ty TNHH Bảo Vệ Dữ Liệu Cá Nhân Quốc Gia, với sự đồng hành của Luật sư Nguyễn Tiến Hảo, cam kết mang đến giải pháp toàn diện và chuyên nghiệp nhất.

Website: dpo.vn

Hotline: 0914.315.886

Email: info@dpo.vn

Địa chỉ: Phòng 86, Tầng 6, Toà tháp Ngôi Sao, phố Dương Đình Nghệ, Khu đô thị mới Cầu Giấy, Phường Yên Hoà, Quận Cầu Giấy, Thành phố Hà Nội, Việt Nam.

Tài liệu tham khảo

- Luật Bảo vệ dữ liệu cá nhân 91/2025/QH15.

- Nghị định 13/2023/NĐ-CP của Chính phủ về bảo vệ dữ liệu cá nhân.

- Cổng Thông tin điện tử Bộ Công an.

- The EU Artificial Intelligence Act.

- Báo cáo AI Index 2024 từ Stanford University.

Doanh nghiệp có trách nhiệm kiểm tra tiêu chuẩn bảo mật của nhà cung cấp AI không?